Innehåll

F:

Varför köra maskininlärningsutbildning (ML) på en lokal maskin och sedan köra regelbundet körning på en server?

A:

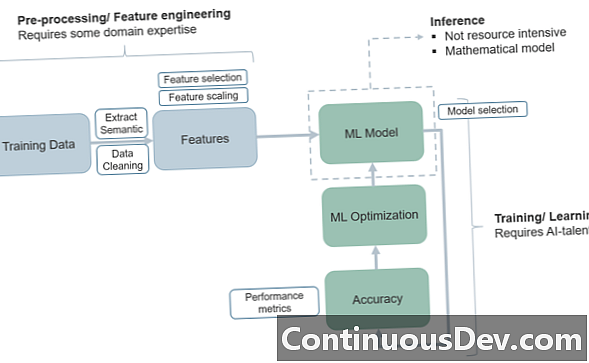

Frågan om hur man strukturerar ett maskininlärningsprojekt och dess tåg- och testfaser har mycket att göra med hur vi går genom ML-livscykeln och tar med programmet från en träningsmiljö till en produktionsmiljö.

Ett av de enklaste skälen till att använda ovanstående modell för att sätta ML-utbildning på en lokal maskin och sedan flytta exekvering till ett serverbaserat system är fördelen med väsentlig uppdelning av uppgifter. I allmänhet vill du att träningsuppsättningen ska isoleras, så att du får en tydlig bild av var träningen börjar och slutar, och var testningen börjar. Den här KDNuggets-artikeln talar om principen på ett grovt sätt samtidigt som det går igenom några av de andra skälen för att isolera träningsuppsättningar på en lokal maskin. Ett annat förslag till grundläggande värden för denna modell är att du, med utbildnings- och testuppsättningarna på mycket olika arkitekturer, aldrig kommer att förväxlas om gemensamt tåg / testallokering!

En annan intressant fördel har att göra med cybersäkerhet. Experter påpekar att om du har de första tågprocesserna på en lokal maskin, behöver den inte vara ansluten till internet! Detta breddar säkerheten på ett grundläggande sätt, "inkuberar" processen tills den träffar produktionsvärlden, där du då måste bygga tillräcklig säkerhet i servern.

Dessutom kan några av dessa "isolerade" modeller hjälpa till med problem som konceptdrift och dolda nackdelar - principen om "icke-stationalitet" varnar utvecklare för att data inte "förblir desamma" över tiden (beroende på vad som mäts) och att det kan krävas mycket anpassningsförmåga för att få en testfas att matcha en tågfas. Eller i vissa fall smälter tåg- och testprocesserna samman och skapar förvirring.

Att distribuera testfasen på en server för första gången kan underlätta olika "black box" -modeller där du åtgärdar problemet med anpassningsbarhet. I vissa fall eliminerar det den överflödiga processen att placera ändringsorder på flera plattformar.

Då serverar servermiljön uppenbarligen realtids- eller dynamiska processer där ingenjörer vill komma åt dataöverförings- och kodmodeller som fungerar bäst för produktion i ML. Till exempel kan AWS Lambda vara ett attraktivt alternativ för att hantera produktionsmikrofunktioner (eller en kombination av Lambda och S3-objektlagring) och utan anslutning (utan server) som blir omöjligt.

Detta är några av de problem som utvecklare kan tänka på när de överväger hur man delar upp utbildnings-ML-faser från testning och produktion.